Selon une étude menée par Jabra et la London School of Economics, les échanges vocaux avec l’intelligence artificielle pourraient devenir, d’ici 2028, le principal mode d’interaction dans les environnements professionnels. Cette évolution intervient alors que les grands acteurs du secteur technologique conçoivent déjà de nouveaux appareils centrés sur la voix et les capteurs, à l’image des prototypes développés par OpenAI et Jony Ive.

Étude de Jabra / LSE : La voix comme future interface principale avec l’IA au travail ?

L’étude menée par Jabra et la London School of Economics and Political Science (LSE), publiée en octobre dernier, met en lumière un basculement déjà amorcé. 14 % des travailleurs du savoir privilégient aujourd’hui les échanges vocaux lorsqu’ils collaborent avec une IA, un taux qui dépasserait le seuil traditionnel des « early adopters » et signalerait une adoption élargie imminente. Les chercheurs estiment que cette modalité devrait devenir majoritaire d’ici 2028.

Les données recueillies soulignent que ce mode d’interaction transforme le rapport des utilisateurs aux outils intelligents. L’étude observe ainsi une hausse de 33 % de la confiance envers l’IA lorsqu’elle est sollicitée par la voix plutôt que par écrit. Nombre de participants décrivent les échanges oraux comme plus directs et plus engageants, un ressenti qui favoriserait la collaboration. En parallèle, la voix se révèle particulièrement adaptée aux tâches nécessitant rapidité, génération d’idées ou réponses immédiates. Même si ses performances diminuent de 20 % pour des activités exigeant argumentation ou précision approfondie.

L’étude s’intéresse également aux facteurs d’adoption et relève un résultat contre-intuitif. Après un premier essai, les professionnels plus âgés s’approprient souvent plus vite les interfaces vocales que la génération Z, pourtant habituée aux assistants vocaux dans la sphère personnelle : Alexa, Siri via Apple Intelligence, etc. Ce contraste suggère que l’usage professionnel impose des logiques différentes de celles observées dans la vie quotidienne.

« L’IA générative s’apprête à bouleverser les modes de travail, mais cela ne sera possible que si nous pouvons interagir avec elle de manière naturelle et efficace », affirme Jean-Baptiste Pain, Président directeur de l’Europe du Sud chez Jabra.

Selon lui, cela implique une captation vocale fidèle dans tous les environnements de travail, notamment grâce à l’expertise de Jabra. Un point que confirme Michael Muthukrishna, professeur à la LSE, pour qui « nous entrons dans une ère de l’informatique conversationnelle, où la parole et l’écoute viennent compléter, voire supplanter la saisie manuelle et la lecture ».

« Intelligence ambiante » : le prototype de compagnon IA portatif d’OpenAI et Jony Ive

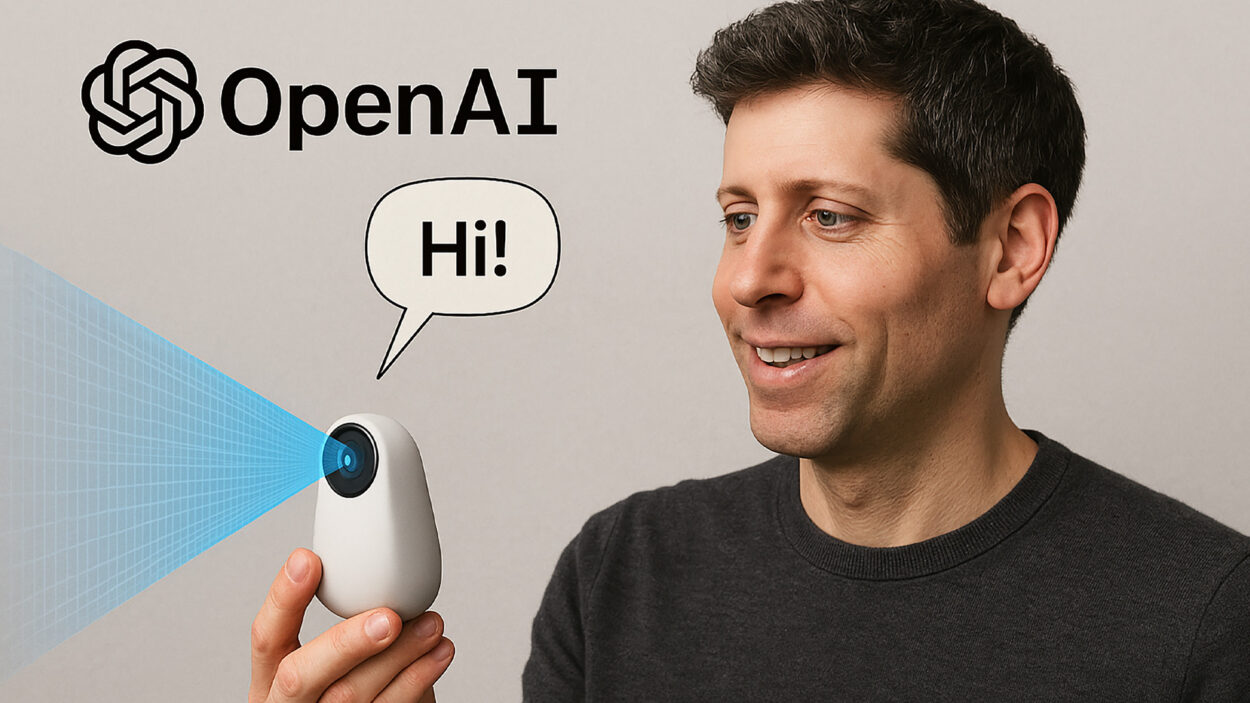

Cette généralisation annoncée des interactions vocales intervient dans un contexte où les interfaces matérielles évoluent elles aussi vers une logique plus intuitive. Fin novembre, lors du Demo Day 2025 d’Emerson Collective, OpenAI en a d’ailleurs révélé un peu plus sur son premier prototype conçu avec Jony Ive, au micro de Laurene Powell Jobs, la veuve de Steve Jobs.

Il s’agirait d’un appareil sans écran fonctionnant en continu grâce à une architecture dite d’« intelligence ambiante ». Ce dispositif, doté de multiples capteurs incluant caméras et microphones, analyserait son environnement et adapterait ses réponses en fonction d’un contexte utilisateur persistant.

Imaginé pour être transporté facilement ou posé sur un bureau, l’objet mise sur un aspect minimaliste fidèle aux principes historiques de Jony Ive, ancien responsable du design chez Apple. Sam Altman a évoqué un « compagnon » IA conçu pour se manipuler aisément et qui tiendrait dans la poche. Il serait potentiellement complété, selon certains journalistes, par un mini-projecteur projetant les informations plutôt qu’un affichage classique.

Sam Altman avait présenté ce concept en réunion dès le mois de mai, décrivant un objet capable « d’analyser parfaitement l’environnement et la vie de l’utilisateur ». Ce projet, entre autres, impliquerait des collaborations techniques avec des fournisseurs habituels d’Apple, comme Luxshare ou Goertek, et mobiliserait une équipe composée de nombreux anciens ingénieurs de Cupertino. D’après la récente newsletter de Mark Gurman, de Bloomberg, ce départ massif d’ingénieurs inquièterait d’ailleurs Apple.

Vers une nouvelle génération d’objets OpenAI conçus pour intégrer l’IA

OpenAI explorerait par ailleurs différents formats : appareils de bureau, objets portables ou dispositifs portés sur soi. Selon une enquête de The Information publiée en septembre dernier, plusieurs pistes seraient à l’étude, dont un appareil évoquant une enceinte sans écran, un enregistreur vocal, ou encore des lunettes connectées, à l’instar des Meta Ray-Ban Display de Mark Zuckerberg.

L’intérêt croissant pour les interfaces vocales s’inscrit ainsi dans un mouvement plus large : la volonté d’inventer des appareils spécifiquement conçus pour l’IA, et non d’adapter des supports antérieurs comme les smartphones ou les ordinateurs. Au printemps, Sam Altman et Jony Ive résumaient cette ambition en la comparant aux technologies actuelles :

Malgré la capacité des ordinateurs à désormais « voir, penser et comprendre », « notre expérience reste façonnée par les produits et interfaces traditionnels ».

Si les prototypes évoqués aboutissent, les premiers produits pourraient être commercialisés d’ici 2027, avec la promesse de dispositifs capables de s’intégrer naturellement au quotidien. Il reste toutefois à démontrer que ces objets trouveront leur place sur un marché où d’autres acteurs (Amazon, Google ou Meta) n’ont pas encore réussi à imposer durablement des appareils spécifiquement dédiés à l’IA.

Par ailleurs, des objets similaires, comme l’AI Pin de Humane et le Rabbit R1, n’ont pas rencontré le succès escompté. Ils ont même été critiqués par Jony Ive, qui les avait par le passé qualifiés de « produits de mauvaise qualité ». Plusieurs PDG de géants de la tech, à l’instar d’Elon Musk, sont en tout cas persuadés que nos smartphones sont voués à disparaître, au profit d’interfaces connectées à l’IA.

L’essor des interactions vocales, désormais perçues comme un levier de collaboration et de productivité, annonce, selon l’étude de Jabra et la LSE, un changement d’échelle dans les usages professionnels de l’IA. En parallèle, les projets matériels menés par OpenAI et Jony Ive ouvrent la voie à une nouvelle génération d’objets intelligents, conçus dès l’origine pour des interactions naturelles, continues et contextuelles. Cette convergence entre étude des usages et innovation matérielle esquisse la prochaine étape de l’informatique conversationnelle. Et vous, abandonneriez-vous votre smartphone pour de telles technologies ?

Certains liens de cet article peuvent être affiliés.

L’évolution vers des interfaces vocales pour interagir avec l’IA est fascinante ! J’ai hâte de voir comment cela transformera notre façon de travailler. Moins de claviers, plus de créativité !

L’utilisation croissante de la voix dans nos interactions avec l’IA pourrait transformer notre manière de travailler. C’est fascinant de voir comment la technologie peut favoriser l’harmonie entre la nature et le design.

L’essor des interactions vocales est fascinant ! Je me demande comment ces nouvelles technologies vont transformer notre manière de travailler au quotidien. Êtes-vous prêt à les adopter ?

L’avenir des interactions vocales avec l’IA me fascine. Imaginez un monde où la technologie s’inspire davantage de la nature et crée des connexions plus humaines. C’est une belle promesse.

Cet article sur l’avenir des échanges avec l’IA m’inspire énormément ! L’idée de communiquer naturellement avec la technologie évoque la magie des histoires anciennes, mêlant passé et futur.