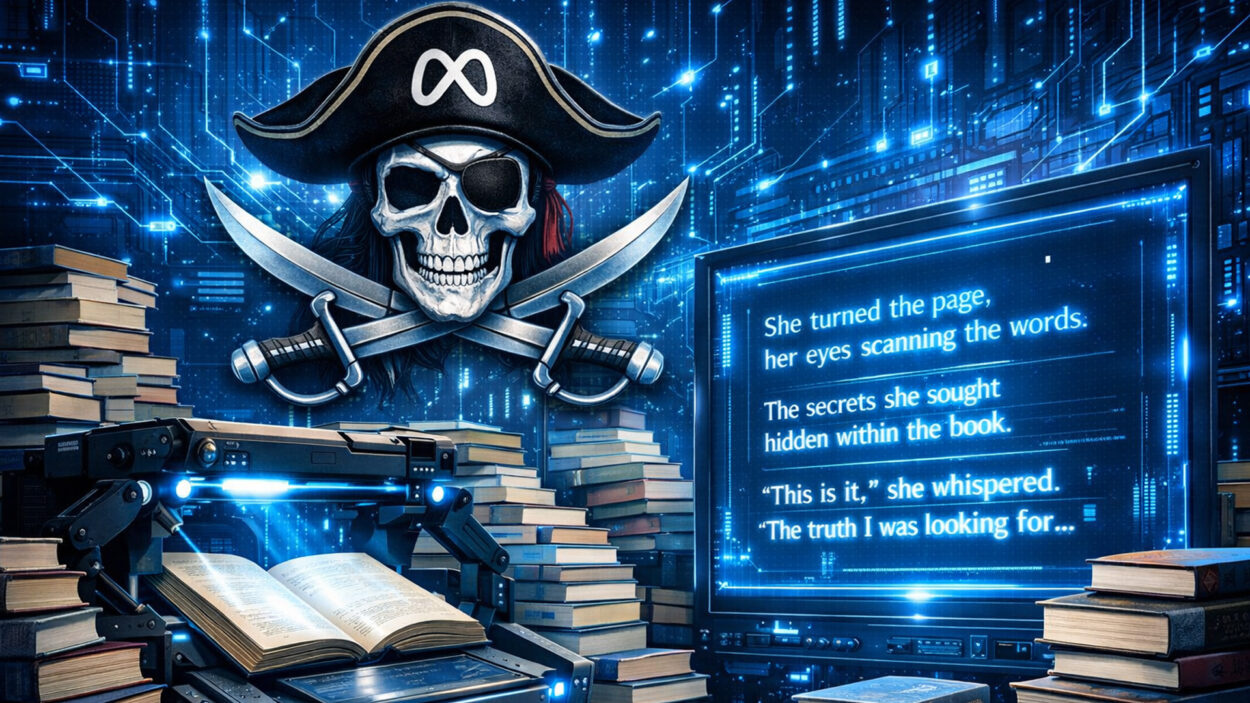

Une enquête de Mediapart met en cause Guillaume Lample, cofondateur et directeur scientifique de Mistral AI, licorne française de l’intelligence artificielle, dans le téléchargement massif de livres protégés lorsqu’il travaillait chez Meta. Une opération visant à alimenter son IA en contenus rédactionnels. Ces révélations relancent le débat sur les pratiques d’entraînement des grands modèles de langage et sur la frontière entre piratage et usage légal des données.

Guillaume Lample et son piratage massif de livres chez Meta

Selon les informations publiées par Mediapart, Guillaume Lample aurait joué un rôle central dans l’utilisation de Library Genesis (LibGen), un site pirate référençant des millions de livres et d’articles scientifiques, pour entraîner le modèle de langage LLaMA de Meta. À partir de documents judiciaires rendus publics dans le cadre de l’affaire « Kadrey v. Meta Platforms Inc. » et d’entretiens avec d’anciens salariés, le média d’investigation affirme que près de 70 téraoctets de données (soit 70 000 Go) auraient été téléchargés à l’automne 2022.

À cette période, les équipes du laboratoire FAIR de Meta (Fundamental Artificial Intelligence Research) cherchaient à combler leur retard face à ChatGPT et Midjourney en développant leur propre grand modèle de langage. Une direction d’ailleurs à contre-courant de celle initiée par le Français Yann LeCun en tant que directeur de FAIR, et qui l’a récemment poussé à quitter Meta. Guillaume Lample, alors chercheur chez Meta, aurait encouragé le recours à LibGen pour accélérer le développement du modèle. Des journaux de téléchargement et des éléments de code mentionnés par Mediapart attesteraient de cette activité, menée via un protocole Torrent.

Après la publication de la première version de LLaMA en février 2023, qui n’aurait finalement pas fait usage de ces données, Meta aurait brièvement envisagé d’acheter des licences d’ouvrages protégés, avant de renoncer et de se tourner de nouveau vers des sources gratuites. L’enquête indique également que les téléchargements depuis des plateformes pirates se seraient poursuivis chez Meta même après le départ de Guillaume Lample, notamment en mai 2023 via LibGen, puis en 2024 à partir d’Anna’s Archive, un méta-agrégateur regroupant plusieurs bibliothèques illégales telles que LibGen, Sci-Hub ou Z-Library.

Alertes en interne et banalisation des pratiques dans l’IA

Les documents cités par Mediapart révèlent que ces pratiques faisaient débat en interne. Une chercheuse de Meta aurait ainsi exprimé ses réticences en affirmant : « je ne pense pas que nous devrions utiliser des ouvrages piratés, c’est une ligne rouge ». Guillaume Lample lui aurait répondu :

« Tout le monde utilise LibGen. C’est ce qu’OpenAI fait avec GPT-3, ce que Google fait avec PaLM, ce que DeepMind fait avec Chinchilla. Donc on va le faire aussi. »

Cette citation, extraite d’échanges internes de 2022, illustre la perception largement répandue dans le secteur selon laquelle l’usage de bases de données pirates serait une pratique courante pour entraîner les grands modèles de langage. Si Meta affirme ne pas avoir intégré ces données dans la première version publique de LLaMA, le modèle s’appuyait néanmoins sur Books3, une autre base contenant des ouvrages protégés par le droit d’auteur.

© DR, via La Tribune

Procès de Meta, « fair use » et zone grise pour Mistral AI

Sur le plan judiciaire, Meta a remporté en juin le procès « Kadrey v. Meta Platforms Inc. » aux États-Unis. Le juge a estimé que les plaignants n’avaient pas démontré de préjudice suffisant et a reconnu l’application du « fair use » (« usage équitable »), autorisant l’usage d’oeuvres protégées sous certaines conditions.

Comme le rapporte Presse Citron, les avocats des écrivains, du cabinet Boies Schiller Flexner, affirment pourtant : « Le tribunal a statué que les entreprises d’IA qui « alimentent leurs modèles avec des œuvres protégées par le droit d’auteur sans obtenir l’autorisation des titulaires de ces droits ni les rémunérer » enfreignent généralement la loi ». Face aux « preuves incontestables » de ce piratage de masse chez Meta, les avocats disent ainsi ne pas être d’accord avec la conclusion du tribunal.

Ces révélations rejaillissent sur Mistral AI, cofondée par Guillaume Lample en 2023 et aujourd’hui valorisée plus de 11,7 milliards d’euros. Si l’entreprise française déclare depuis ses débuts faire usage de données de « haute qualité » et passer par des licences, plusieurs anciens employés de Meta cités par Mediapart estiment que LibGen aurait également été utilisé pour entraîner Mistral 7B, le premier modèle de Mistral AI, lancé en septembre 2023. Aucune preuve formelle ne peut toutefois en attester.

Par ailleurs, l’entreprise affirme à Mediapart utiliser « des informations publiques disponibles sur Internet, des jeux de données non publics sous licence auprès de tiers, ainsi que des données générées en interne de manière synthétique ». Depuis l’an dernier, Mistral AI s’implique par exemple dans le projet ArGiMi pour pouvoir accéder aux archives de l’INA et de la BNF. La start-up s’est également associée à l’AFP, début 2025. Toutefois, rien ne nous dit que l’entraînement de son premier modèle ait été réalisé en toute légalité…

L’affaire met en lumière les tensions croissantes autour des données d’entraînement des IA génératives, entre impératifs industriels, respect du droit d’auteur et cadres juridiques encore flous. Si Meta a obtenu gain de cause devant la justice américaine, les interrogations persistent, notamment sur les pratiques passées et présentes des acteurs émergents comme Mistral AI.

Certains liens de cet article peuvent être affiliés.

L’affaire souligne les enjeux éthiques et juridiques fondamentaux entourant l’entraînement des IA. Mistral AI pourrait faire face à des conséquences sérieuses si ces accusations se confirment.

C’est incroyable de voir à quel point l’utilisation de données protégées devient courante dans le secteur de l’IA. Cela soulève des questions importantes sur l’éthique et le respect des droits d’auteur.

L’accusation contre Guillaume Lample soulève des questions cruciales sur l’utilisation éthique des données dans l’IA. C’est un sujet d’actualité qui mérite d’être débattu en profondeur.

Cette situation avec Guillaume Lample et Mistral AI soulève vraiment des questions sur l’éthique dans l’IA. Les limites entre innovation et respect des droits d’auteur semblent floues. Il faut réfléchir à tout ça !

Cette enquête soulève des interrogations cruciales sur l’éthique du traitement des données dans l’IA. Les entreprises doivent vraiment clarifier leurs méthodes pour respecter les droits d’auteur tout en innovant.