Google poursuit l’intégration de fonctions créatives au sein de son application Gemini avec Lyria 3, un nouveau modèle d’intelligence artificielle dédié à la génération musicale. Disponible depuis le 18 février en version bêta sur le web et en cours de déploiement sur mobile, cet outil permet de produire des morceaux de 30 secondes à partir de simples instructions textuelles ou visuelles.

Lyria 3 : Générer de la musique à partir d’un prompt sur Gemini

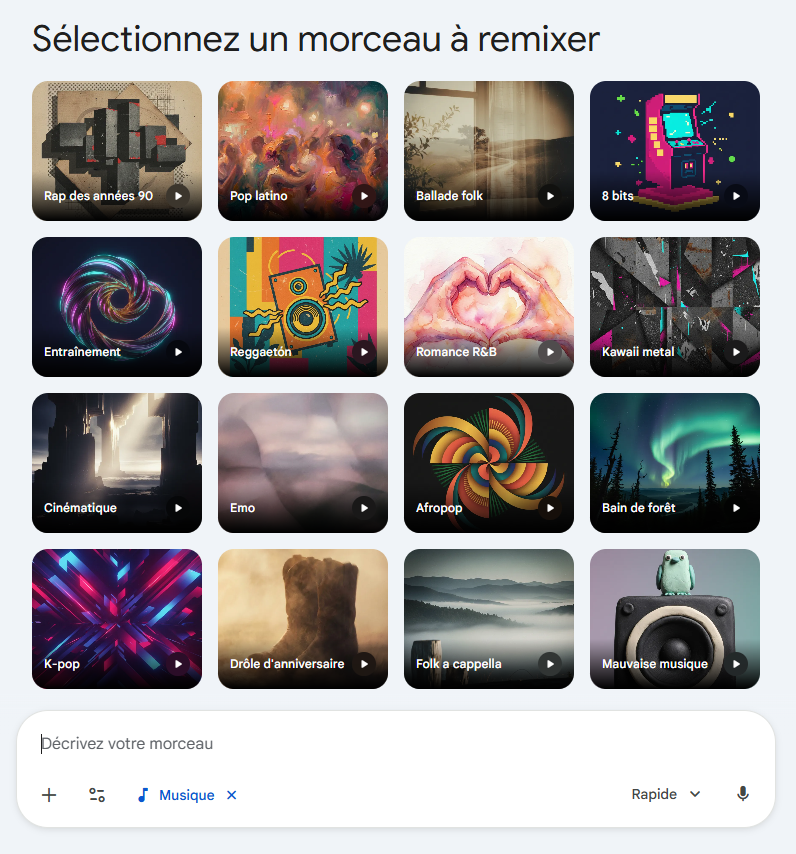

Avec Lyria 3, Google introduit pour la première fois dans Gemini la possibilité de créer des sons ou des chansons à partir d’une commande écrite. L’utilisateur peut décrire un style musical, un tempo, des instruments, une ambiance ou encore un thème de paroles afin de générer automatiquement une piste audio. On peut même importer une image, le modèle analysant alors son atmosphère pour produire une musique correspondante.

Cette IA permet aussi de générer automatiquement des paroles sans avoir à les rédiger soi-même, tout en conservant la possibilité d’ajuster certains paramètres comme le style vocal ou le rythme. Le modèle prend en charge plusieurs langues, dont le français, l’anglais, l’allemand, l’espagnol, le japonais ou encore le portugais. Les morceaux produits peuvent être exportés au format MP3 ou sous forme de vidéo accompagnée d’une image fixe générée par Nano Banana, le modèle de création visuelle de Google.

Selon Google, Lyria 3 a été conçu pour comprendre des éléments musicaux comme le rythme ou l’arrangement, afin de créer des pistes cohérentes présentant un enchaînement fluide de notes du début à la fin. Le modèle permettrait ainsi de transformer des idées rapides en morceaux « de qualité professionnelle », qu’il s’agisse d’une ambiance sonore ou d’un titre destiné à illustrer un projet.

Un écosystème multimodal avec Gemini et YouTube

L’intégration directe de Lyria 3 à Gemini vise à rendre la création musicale accessible à grande échelle, en s’appuyant sur la complémentarité avec d’autres modèles développés par Google. Gemini intervient pour l’analyse textuelle ou visuelle, Nano Banana pour la génération d’images, comme les pochettes des morceaux, tandis que Veo peut produire des contenus vidéo associés.

Le modèle peut être utilisé par les abonnés gratuits comme payants, bien que les formules Google AI Plus, Pro et Ultra offrent des limites d’utilisation plus élevées. Google prévoit également une intégration dans ses outils destinés aux créateurs, notamment Dream Track sur YouTube, afin de générer des bandes-son et améliorer la qualité des musiques utilisées dans les Shorts.

En parallèle, Lyria RealTime constitue une déclinaison interactive permettant de générer un flux musical continu en temps réel. Ce modèle autorise un contrôle instantané de paramètres tels que la tonalité, le tempo ou la densité sonore, tout en mélangeant différents styles ou instruments à la volée. Il peut par exemple être utilisé via l’outil de création musicale IA MusicFX DJ de Google Labs, qui n’est, par contre, pas encore disponible en France.

Musique IA sur Gemini : encadrement juridique et limites techniques

La durée maximale des morceaux générés par Lyria 3 reste pour l’instant limitée à 30 secondes. Une contrainte qui pourrait viser à éviter la création de titres complets exploitables commercialement. Google précise également que les contenus produits incluent un marquage numérique SynthID, comparable à ses filigranes sur Nano Banana et Veo, qui sont destinés à identifier les créations issues de ses modèles d’IA.

L’entreprise indique par ailleurs que Gemini ne reproduit pas la voix d’artistes existants. « Si votre requête nomme un artiste spécifique, Gemini prendra cela comme une inspiration créative au sens large et créera une piste qui partage un style ou une ambiance similaire. Nous avons aussi mis en place des filtres pour vérifier les résultats par rapport aux contenus existants », précise Google.

Sa règlementation interdit en outre toute atteinte aux droits de propriété intellectuelle ou à la vie privée, dans un contexte où la génération automatisée de musique soulève des questions juridiques croissantes. Ces derniers mois, les deux principaux modèles IA de génération musicale, Suno et Udio, ont d’ailleurs fait l’objet de poursuites judiciaires, lancées par des maisons de disques.

Avec Lyria 3, Google ajoute une nouvelle brique à son écosystème de création assistée par IA, en permettant la génération de musique directement depuis Gemini. Si ses capacités restent limitées à des formats courts, son intégration à d’autres outils multimodaux et ses mécanismes de traçabilité pourraient en faire un instrument plébiscité aussi bien par les amateurs que les créateurs de contenus. Et vous, l’avez-vous déjà testé ? Qu’en pensez-vous ?

Certains liens de cet article peuvent être affiliés.

C’est génial de voir Google s’engager dans la musique assistée par IA ! Je suis curieux d’essayer Lyria 3 pour voir si elle peut vraiment donner vie à mes idées créatives.

C’est vraiment super de voir des avancées comme Lyria 3 ! J’adore l’idée de créer de la musique juste avec un prompt. Sacré outil pour les créateurs !

C’est fascinant de voir comment la technologie permet de créer de la musique facilement. J’aimerais essayer Lyria 3 pour voir ce qu’elle peut produire, avez-vous des expériences à partager ?

C’est vraiment fascinant de voir comment Lyria 3 peut créer de la musique à partir d’instructions simples! J’ai hâte de tester cet outil pour mes projets d’IA.

Lyria 3 de Google est fascinant. Générer de la musique avec des mots ouvre de nouvelles possibilités créatives, tant pour les amateurs que pour les professionnels. Hâte de l’essayer !