ChatGPT a été la cible d’une tentative d’espionnage par des comptes venant de plusieurs pays à travers le monde. L’entreprise américaine a d’ores et déjà pris des sanctions en bannissant les comptes frauduleux.

Chronologie des faits

- 5 juin 2025 : OpenAI publie son bilan trimestriel, signalant 10 cas majeurs de détournement, dont 4 attribués à la Chine.

- 5 juin 2025 : Le New York Post précise l’opération « Uncle Spam » et sa méthodologie.

- 9 juin 2025 : date de publication du rapport détaillé « Disrupting malicious uses of AI: June 2025 ».

La Chine, comme menace la plus présente

Dans un récent rapport de menace datant du 9 juin 2025, OpenAI révèle avoir identifié dix campagnes orchestrées via ChatGPT, impliquant des acteurs étatiques ou à coloration étatique. Au premier rang des pays ciblés par le rapport d’Open AI figure la Chine. Les Groupes APT5 & APT15 (Keyhole/Vixen Panda) auraient utilisé ChatGPT pour du pentesting, configurer des scripts de brute force, administrer des serveurs Linux/Android, et automatiser les interactions sur les réseaux sociaux.

Qu’est-ce que le Pentesting ?

Un pentest, ou test d’intrusion, est en quelque sorte une « cyberattaque préventive » réalisée à la demande d’une organisation pour évaluer la robustesse de ses systèmes d’information (SI). Elle consiste à tenter de s’infiltrer dans un réseau, un site internet, une application, un objet connecté pour identifier les failles potentielles et les corriger avant qu’il ne soit trop tard.

« Cela semble plutôt destiné à exploiter les divisions politiques existantes qu’à promouvoir une position idéologique spécifique. » analyse le New York Post.

Selon les conclusions du rapport, des campagnes d’influence comme « Sneer Review» et « Uncle Spam » créaient des posts ambivalents sur Taiwan, les droits pakistanais ou les aides américaines, avec avatars AI pour simuler des vétérans US.

« Sur les dix cas d’utilisation abusive signalés, quatre semblaient impliquer des acteurs chinois. » rappelle le Wall Street Journal.

La Russie et la Corée du Nord également épinglées

La Russie fait également partie des pays mis en cause par le rapport de Open AI. Un groupe russophone aurait utilisé un logiciel Windows malveillant baptisé « ScopeCreep pour déboguer du code multilingue et à configurer son infrastructure de commandement et de contrôle », explique Open AI dans son rapport. Par ailleurs, la Russie auraient aussi profité de ChatGPT à des fins de politiques internationales. Des texte en russe auraient été générés pour commenter les élections allemandes de 2025.

Autres acteurs cités par Open AI, des groupes nord-coréens auraient utilisé les modèles de ChatGPT pour mener des campagnes d’emploi trompeuses en développant des supports susceptibles de faire progresser leurs tentatives frauduleuses de candidature à des emplois informatiques, d’ingénierie logicielle et d’autres emplois à distance dans le monde entier.

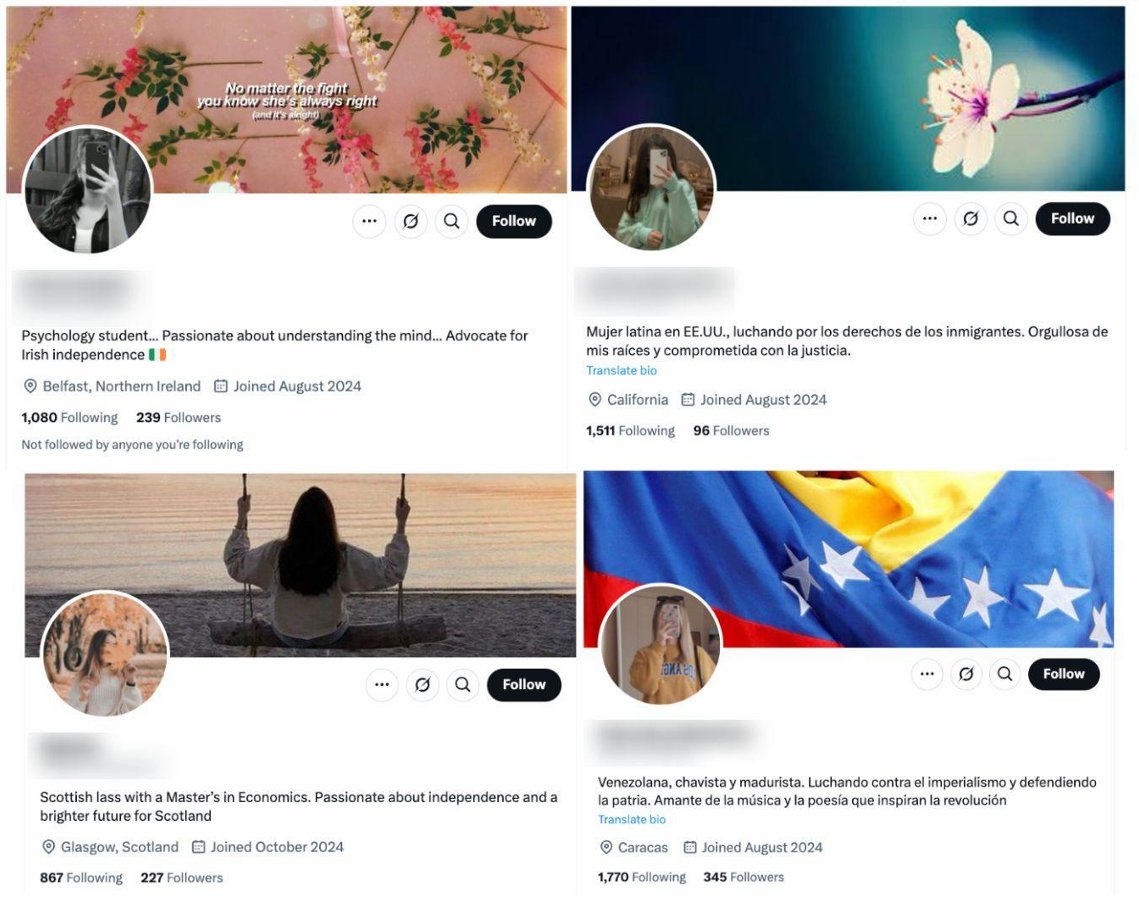

L’Iran utilise ChatGPT pour atteindre des raisons géopolitiques

L’Iran est fait partie des cibles recensées par Open AI mais pour des motifs d’une autre nature que les groupes chinois, russes ou nord-coréens. Le pays du Proche-Orient est suspecté d’avoir utilisé ChatGPT pour générer des commentaires exprimant le soutien aux latinos, à l’indépendance de l’Ecosse, aux droits des Palestiniens, mais aussi des messages pour saluer leur puissance militaire et diplomatique. Cette campagne d’influence serait baptisée « opération Storm 2035 ».

Dans le même esprit le Cambodge et les Philippines ont également détourné l’usage de ChatGPT en diffusant des courts commentaires sur la situation politique actuelle et manifester un soutien à des gouvernements étrangers. Les campagnes philippines et cambodgiennes visaient à recruter via des task‑scams multilingues, avec paiement de frais d’entrée, stratégie confirmée par Meta.

Open AI reconnaît une faille mais se veut rassurant

Bien qu’il reconnaisse que son IA a pu être instrumentalisée par des puissances étrangères, Open AI s’est voulu rassurant sur les répercussions de cette attaque en indiquant qu’aucun avantage supplémentaire ou révolutionnaire n’a pu être obtenu par les différents acteurs en comparaison avec ce qu’il pouvait obtenir ailleurs.

Le Financial Time indique que les attaques comme celle dont ChatGPT aurait été la victime serait de plus en plus importantes et rapides raison des LLM comme GPT 4o. OpenAI n’a pas seulement banni des comptes : elle analyse, détecte et partage les indicateurs de menace avec d’autres acteurs, réseaux sociaux, chercheurs, plateformes.

Qu’est-ce qu’un LLM ?

Un grand modèle linguistique (Large Language Model, LLM) est un type de programme d’intelligence artificielle (IA) capable, entre autres tâches, de reconnaître et de générer du texte. Les LLM sont entraînés sur de vastes ensembles de données, d’où l’emploi du terme « large » (grand) dans la dénomination anglaise.

ChatGPT : cheval de Troie ou outil de défense ? Pour l’instant, il reste un miroir du pire comme du meilleur. Les opérations détectées étaient encore artisanales et à petite échelle, mais elles tracent la voie vers un futur où les LLM sont des armes aussi bien que des outils. Une évolution qui devrait poser la question de la régulation de l’IA et son utilisation.

Cet article vous a-t-il éclairé ? Partagez vos réflexions ou expériences ci-dessous. Si vous avez repéré une imprécision ou souhaitez suggérer une rectification écrivez nous dans les commentaires.

Certains liens de cet article peuvent être affiliés.