Des vidéos générées par intelligence artificielle, produites en masse et à faible valeur créative, s’imposent progressivement sur les grandes plateformes sociales. Sur YouTube en particulier, ces contenus, qualifiés d’« AI slop » (« bouillie IA »), sont désormais largement mis en avant par les algorithmes, soulevant des questions économiques, culturelles et informationnelles.

Plus de 20 % des recommandations YouTube concernées par « l’AI slop »

Le phénomène est désormais quantifié. Selon une étude menée par la société d’édition vidéo Kapwing, et citée par The Guardian, plus de 20 % des vidéos recommandées à de nouveaux utilisateurs YouTube seraient de l’« AI slop », c’est-à-dire des contenus générés par IA, conçus pour capter l’attention plutôt que pour informer ou créer. Sur un compte test, 104 des 500 premières vidéos proposées relevaient de cette catégorie, tandis qu’un tiers des recommandations entraient dans la catégorie plus large du « brainrot », des contenus de très faible qualité destinés à être monétisés.

Kapwing a également analysé les 100 chaînes les plus populaires dans chaque pays et identifié 278 chaînes produisant exclusivement ce type de vidéos. À elles seules, elles totalisent plus de 63 milliards de vues, 221 millions d’abonnés et généreraient environ 117 millions de dollars de revenus publicitaires par an. La répartition est mondiale : l’Espagne concentre environ 20 millions d’abonnés à ces chaînes, soit quasiment la moitié de sa population, contre 18 millions en Égypte, 14,5 millions aux États-Unis et 13,5 millions au Brésil.

Certaines chaînes illustrent cette dynamique. Bandar Apna Dost, basée en Inde, cumule plus de 2 milliards de vues avec des scénarios mettant en scène un singe anthropomorphe et un personnage inspiré de Hulk. Selon Kapwing, la chaîne, la plus vue dans le domaine de l’IA, pourrait générer jusqu’à 4,25 millions de dollars par an. Pour la chercheuse Rohini Lakshané, sa popularité s’expliquerait par « son absurdité, ses tropes hypermasculins et l’absence de narration, qui la rend facile d’accès pour de nouveaux publics », rapporte The Guardian.

Un modèle économique optimisé pour les algorithmes

Derrière ces vidéos se dessine un véritable écosystème industriel. Comme l’explique le journaliste Max Read, spécialiste du sujet, « il existe des groupes sur Telegram, WhatsApp, Discord et des forums où les gens échangent des astuces et vendent des formations sur la manière de produire du slop suffisamment engageant pour rapporter de l’argent ». Les créateurs seraient majoritairement basés dans des pays à revenu intermédiaire, comme l’Inde, le Nigeria, le Kenya, le Brésil ou le Vietnam, où les revenus YouTube peuvent dépasser les salaires locaux.

Ces créateurs fonctionnent par niches, testant en continu des formats et sujets susceptibles d’être favorisés par les algorithmes et plébiscités par les internautes. Selon Read, la production humaine compte finalement moins que la capacité à exploiter les systèmes de recommandation : « Ces sites sont, par nature, d’immenses machines de tests A/B […] La question est donc : comment repérer ce qui fonctionne plutôt bien, puis comment le déployer à grande échelle ? »

YouTube affirme toutefois maintenir une ligne officielle inchangée. Un porte-parole de la plateforme a déclaré : « L’IA générative est un outil, et comme tout outil, elle peut servir à produire des contenus de haute ou de basse qualité. Nous restons concentrés sur la mise en relation de nos utilisateurs avec des contenus de qualité, quelle que soit la manière dont ils ont été créés. »

Fake news, faux trailers IA et saturation des réseaux sociaux

Au-delà de la saturation, l’AI slop pose aussi un problème de désinformation. YouTube a récemment fermé deux chaînes de faux trailers générés par IA, Screen Culture et KH Studios, après qu’elles ont cumulé des milliards de vues en diffusant de fausses bandes-annonces de films et séries, notamment pour la première saison de Harry Potter de HBO Max. Bien que certaines vidéos aient été présentées comme des « concept trailers », leur réalisme croissant rendait la distinction difficile pour les spectateurs, d’autant plus qu’elles apparaissaient parfois avant les contenus officiels dans les résultats de recherche.

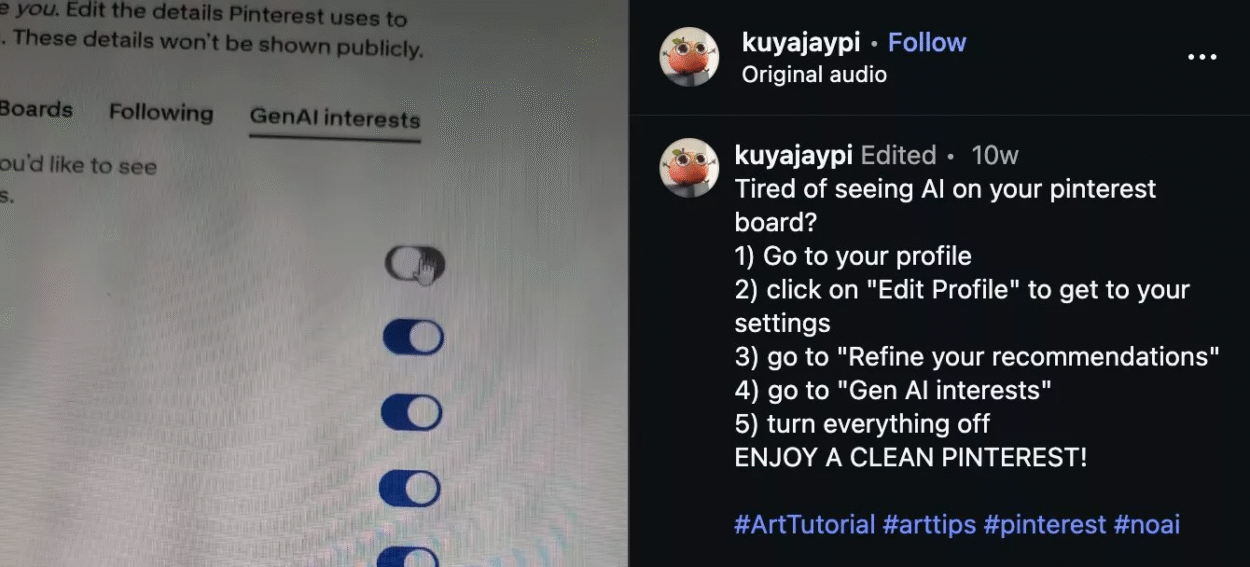

Ce brouillage dépasse YouTube. Récemment, Emmanuel Macron a demandé, sans succès, à Meta de retirer une vidéo d’un faux coup d’Etat en France ayant fait plus de 13 millions de vues sur Facebook. D’après Numerama, sur Pinterest également, de nombreux utilisateurs dénoncent une invasion de contenus générés par IA, souvent sponsorisés. Le magazine Wired rapporte que pour certaines recherches, plus de 40 % des premières épingles affichées sont des annonces, fréquemment optimisées ou produites par IA. Une partie renvoie vers des boutiques factices, composées elles-mêmes d’images et de textes synthétiques, et monétisées par des publicités. Lassés, certains utilisateurs quittent la plateforme. Sur Reddit, l’un d’eux résume la situation par un laconique : « RIP Pinterest ».

Face à ces critiques, Pinterest a introduit fin 2025 une option permettant de limiter la présence de contenus générés par IA dans les recommandations. Une décision prise alors que son action a chuté d’environ 20 % après des prévisions financières jugées décevantes. Malgré ces efforts, des utilisateurs se plaignent toujours de voir des contenus IA de basse qualité dans leur fil d’actualités.

Avec de nouvelles plateformes comme Sora d’OpenAI, entièrement dédiées à la création et au partage de vidéos IA et de deepfakes, l’AI slop est aujourd’hui omniprésent. Il s’impose notamment par sa capacité à exploiter les algorithmes et la curiosité de certains internautes. Son avenir reste toutefois incertain. Entre désinformation, rejet d’une partie des utilisateurs et interventions ponctuelles des plateformes, l’équilibre entre automatisation et création humaine demeure fragile. Une chose est sûre : la question est devenue centrale pour l’économie des réseaux sociaux.

Certains liens de cet article peuvent être affiliés.